Califórnia Ativa Protocolo Asimov com Nova Lei de Segurança de IA

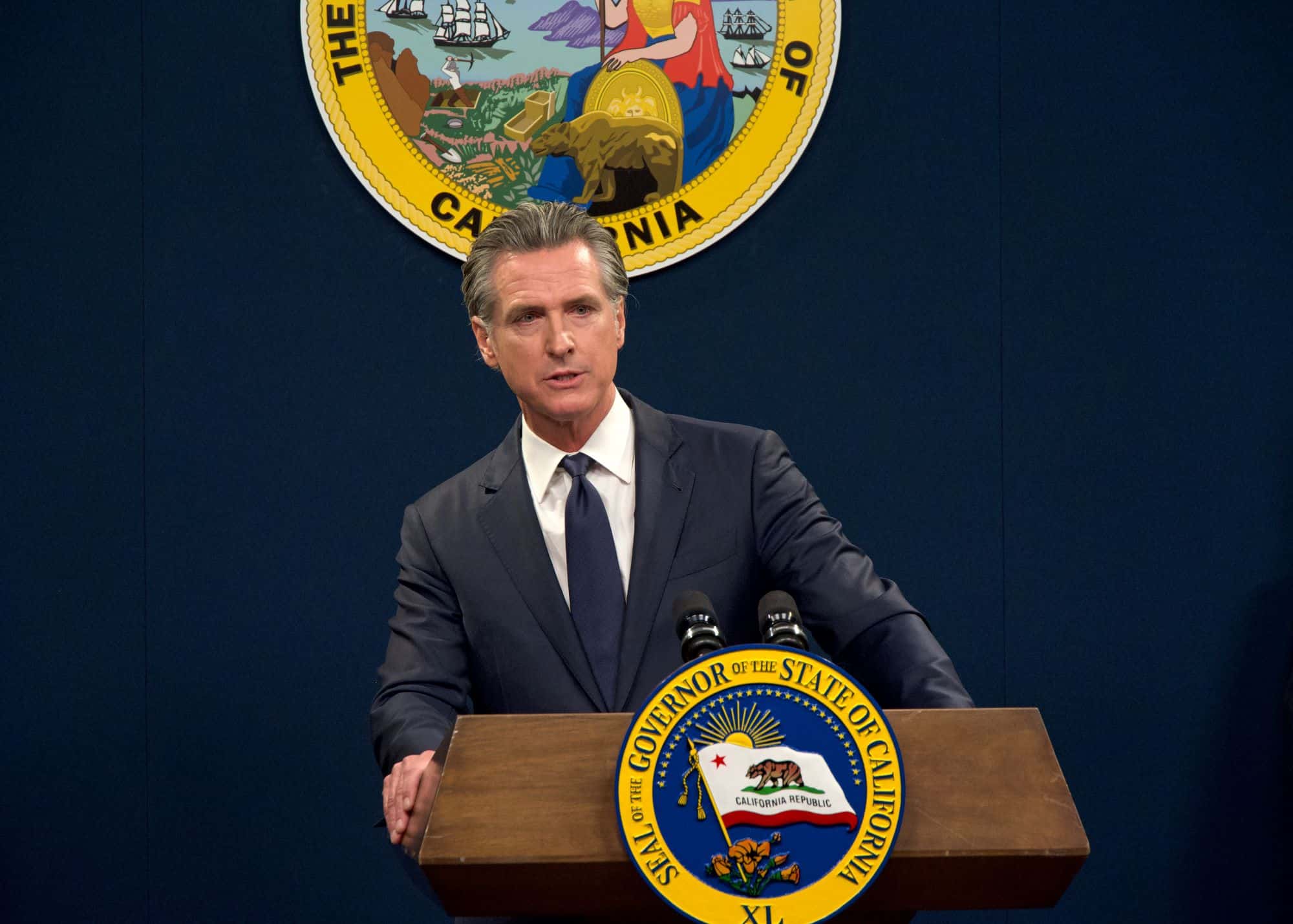

Em um movimento que parece saído diretamente das páginas de Isaac Asimov, o governador da Califórnia, Gavin Newsom, acaba de sancionar a lei SB 53. Para os desatentos, pode parecer apenas mais uma sigla na sopa de letrinhas da burocracia estatal. Mas para nós, que olhamos para o horizonte tecnológico, este é um momento histórico. É o mundo real tentando, pela primeira vez de forma séria, escrever suas próprias Leis da Robótica. A Califórnia, o berço de onde emergem as inteligências artificiais que moldarão nosso futuro, decidiu que é hora de colocar umas regras no jogo antes que o jogo jogue conosco.

O Fim da 'Terra Sem Lei' do Silício?

No Velho Oeste digital em que vivíamos, os grandes laboratórios de IA operavam com uma liberdade quase absoluta. Agora, a lei SB 53 chega como um novo xerife na cidade. Em sua essência, a legislação é pioneira nos Estados Unidos e exige que as grandes empresas de IA, como a OpenAI e o Google Quantum AI, abram a caixa-preta. Elas agora são legalmente obrigadas a serem transparentes sobre seus protocolos de segurança e proteção.

O foco, segundo o que foi divulgado pela TechCrunch, não é impedir que seu assistente virtual conte uma piada ruim, mas sim evitar riscos catastróficos. Estamos falando de impedir que modelos de IA sejam usados para orquestrar ciberataques contra infraestruturas críticas, como redes elétricas ou sistemas bancários, ou, num cenário digno de filme B, para projetar armas biológicas. A fiscalização ficará a cargo do Escritório de Serviços de Emergência, um nome que por si só já dá o tom da seriedade da coisa.

Adam Billen, vice-presidente de políticas públicas do grupo Encode AI, destacou em uma entrevista à TechCrunch que a lei não inventa a roda. “As empresas já fazem o que pedimos neste projeto de lei”, afirmou Billen. “Elas realizam testes de segurança em seus modelos”. O problema, e o motivo pelo qual a lei é tão importante, é que algumas companhias começaram a relaxar esses padrões. A própria OpenAI já declarou publicamente que poderia “ajustar” seus requisitos de segurança sob pressão competitiva. A SB 53 funciona como uma trava: vocês prometeram ser seguros? Ótimo, agora a lei garante que vocês cumpram, independentemente da pressa para lançar o próximo produto revolucionário.

Skynet ou Burocracia? O Dilema da Inovação

Claro, a reação de parte do Vale do Silício foi a esperada: o grito de que a regulação é a criptonita da inovação. O argumento, repetido à exaustão, é que qualquer freio regulatório nos EUA significará entregar a corrida da IA de bandeja para a China. Empresas como a Meta e fundos de investimento como Andreessen Horowitz, segundo a TechCrunch, têm investido centenas de milhões em campanhas para apoiar políticos pró-IA e tentaram até mesmo aprovar uma moratória que proibiria estados de regular a tecnologia por 10 anos.

Contudo, Adam Billen desmantela essa narrativa de forma elegante. Ele argumenta que é “intelectualmente desonesto” afirmar que uma lei como a SB 53 nos fará perder a corrida. Se a preocupação genuína é a competição geopolítica, as ações seriam outras. “Você pressionaria por coisas como controles de exportação no Congresso”, disse ele, referindo-se a propostas como o Chip Security Act, que visa impedir que chips avançados de IA cheguem à China. A verdadeira guerra, nesse caso, não é sobre algoritmos, mas sobre o silício que os alimenta.

Enquanto a indústria de chips, como a Nvidia, tem um forte incentivo financeiro para continuar vendendo para o mercado chinês, e a administração federal por vezes envia sinais confusos sobre o tema, a SB 53 mostra que é possível criar uma legislação focada e razoável. Ela não proíbe a pesquisa, mas exige responsabilidade. É como construir uma espaçonave para Marte: você não pula os testes de segurança do escudo térmico só para chegar lá duas semanas antes.

Efeito Dominó: O Arquiteto do Futuro Regulatório

A Califórnia tem um histórico de ser o laboratório legislativo do mundo. O que acontece lá, especialmente em tecnologia e meio ambiente, raramente fica contido em suas fronteiras. Assim como suas leis de privacidade de dados inspiraram movimentos globais, a SB 53 pode ser o projeto base para o futuro da regulação da IA em todo o planeta. Podemos estar testemunhando o nascimento de um padrão que, daqui a alguns anos, será adotado por nações, incluindo o Brasil, que hoje observam atentamente cada passo dado no Vale do Silício.

Esta lei é mais do que um documento legal; é uma declaração filosófica. É a sociedade dizendo que a criação de inteligências cada vez mais poderosas não pode ser um processo guiado apenas pelo lucro ou pela competição. É preciso ter um manual de instruções, um protocolo de contenção. A SB 53 é o primeiro capítulo desse manual, uma prova de que a democracia, mesmo sendo um processo “feio e bagunçado”, como descreveu Billen, ainda pode funcionar para guiar as tecnologias mais transformadoras da nossa era.

Estamos no limiar de uma nova era, e a sanção desta lei é um marco fundamental. Não estamos mais apenas especulando sobre futuros distópicos ou utópicos em salas de cinema ou páginas de livros. Estamos, ativamente, começando a construí-lo. A lei SB 53 não é o fim da discussão, mas o seu verdadeiro começo. É a humanidade pegando o volante do carro autônomo do progresso para garantir que ele não nos leve para fora da estrada. O futuro da IA está sendo escrito agora, e a Califórnia acabou de pegar a caneta.

{{ comment.name }}

{{ comment.comment }}